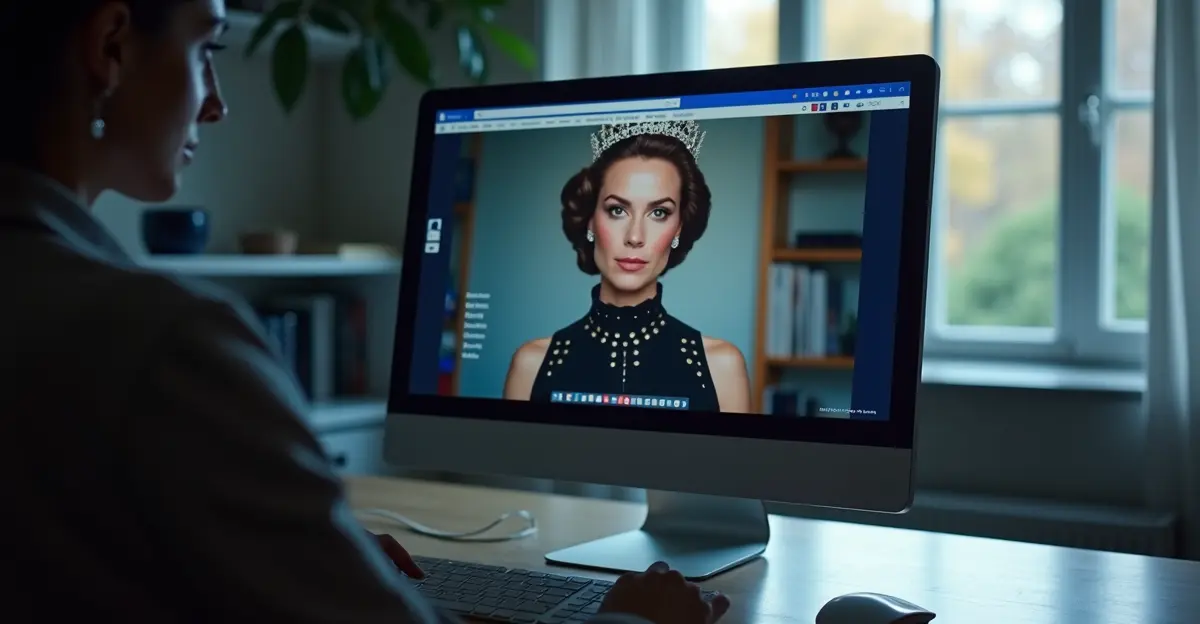

Belgische autoriteiten waarschuwen voor AI-gegenereerde koningsoplichting

Het Belgische Openbaar Ministerie heeft een dringende waarschuwing uitgegeven over geavanceerde oplichtingspraktijken waarbij kunstmatige intelligentie wordt gebruikt om deepfake-video's van koning Filip te creëren. Volgens het Belgische parket en het Centrum voor Cybersecurity België (CCB) doen oplichters zich sinds begin 2025 voor als de Belgische vorst, zijn kabinetschef Vincent Houssiau en majoor-generaal Stéphane Dutron.

Hoe de oplichting werkt

De fraudeurs contacteerden slachtoffers aanvankelijk via WhatsApp, e-mail of telefoongesprekken, waarbij ze beweerden financiële steun nodig te hebben voor de zogenaamde bevrijding van Belgische journalisten die in Syrië zouden zijn gegijzeld. 'De verdachten vroegen daarbij in een eerste fase financiële steun voor de zogenaamde bevrijding van Belgische journalisten die in Syrië zouden zijn gegijzeld,' legde het parket uit.

Hoewel de meeste slachtoffers het bedrog doorhadden, heeft minstens één persoon geld overgemaakt aan de oplichters. Na een korte rustperiode zijn de oplichtingspraktijken begin 2026 weer opgelaaid met een verontrustend nieuw element: slachtoffers worden nu uitgenodigd voor videogesprekken met wat lijkt op koning Filip.

De AI-deepfake dimensie

'Een opvallend nieuw element is dat de slachtoffers worden uitgenodigd voor een videogesprek, in een poging om hen te overtuigen dat het effectief om de koning gaat,' stelden autoriteiten. 'De beelden in dit videogesprek zijn mogelijk gegenereerd door artificiële intelligentie.'

Dit vertegenwoordigt een significante escalatie in online oplichtingstactieken. Volgens onderzoek van Forbes vinden deepfake-aanvallen nu elke vijf minuten plaats en zijn ze goed voor 40% van biometrische fraude, waarbij criminelen AI-gegenereerde nepvideo's en stemklonen gebruiken om miljoenen te stelen.

Extra oplichtingstactieken

Naast de deepfake-videogesprekken sturen oplichters ook valse uitnodigingen voor niet-bestaande galadiners die zogenaamd worden georganiseerd door de Koning Boudewijnstichting in februari en april 2026. Bedrijven wordt gevraagd deze spookevenementen te sponsoren, waarbij fraudeurs geavanceerde technieken gebruiken om communicatie legitiem te laten lijken vanuit het Koninklijk Paleis.

De doelwitten zijn geëvolueerd van buitenlandse hoogwaardigheidsbekleders en Belgische families naar vooral Belgische bedrijfsleiders die mogelijk connecties hebben met of respect hebben voor het koningshuis. Experian's 2026 Future of Fraud Forecast identificeert deepfake-misbruik als een van de top vijf fraudegevaren voor het komende jaar, waarbij wordt opgemerkt dat consumenten in 2024 alleen al meer dan $12,5 miljard aan fraude verloren.

Onderzoek en preventie

Het Federaal Parket voert een onderzoek uit met gespecialiseerde politiediensten, hoewel de identiteit van de daders onbekend blijft. Autoriteiten benadrukken dat noch de koning noch enige legitieme koninklijke instelling ooit rechtstreeks contact zou opnemen met individuen om geld te vragen.

Beveiligingsexperts raden verschillende beschermende maatregelen aan: verifieer verdachte verzoeken altijd via aparte, gevestigde kanalen; wees op uw hoede voor ongevraagde communicatie van vermeende publieke figuren; en let op kenmerkende tekenen van deepfakes zoals onnatuurlijk knipperen, niet-overeenkomende lip-sync of robotachtige audiotonen.

Naarmate AI-technologie toegankelijker wordt, zullen dergelijke geavanceerde identiteitsoplichtingspraktijken waarschijnlijk toenemen, waardoor publieke bewustwording en technologische tegenmaatregelen steeds crucialer worden in de strijd tegen digitale fraude.

Follow Discussion