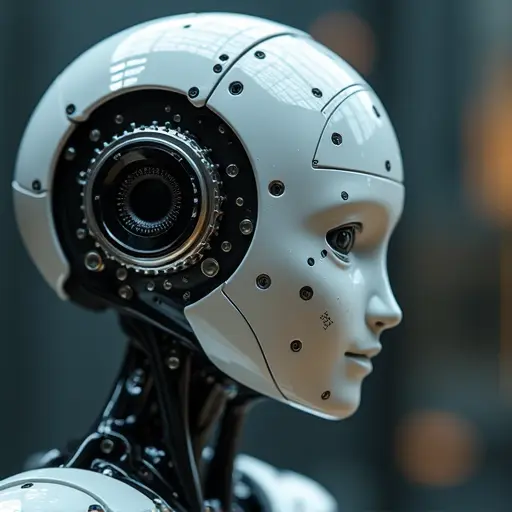

Kunstmatige intelligentie (AI) is een cruciaal instrument geworden in de strijd tegen nepnieuws, waarbij mediabedrijven machine learning-algoritmen gebruiken om desinformatie te identificeren en te markeren. Desondanks hebben AI-systemen nog steeds moeite met het detecteren van geavanceerde deepfakes, wat zorgen oproept over hun betrouwbaarheid.

AI-gebaseerde detectie van nepnieuws analyseert patronen in tekst, afbeeldingen en video's. Natural language processing (NLP)-algoritmen scannen op inconsistenties, sensationele taal of misleidende claims in artikelen. Forensische tools voor afbeeldingen en video's onderzoeken metadata, pixelinconsistenties en andere digitale artefacten om gemanipuleerde content te identificeren.

Toch vormen deepfakes—AI-gegenereerde media die echte mensen nabootsen—een grote uitdaging. Deze creaties gebruiken generative adversarial networks (GANs) om zeer realistische content te produceren, die vaak traditionele detectiemethoden omzeilt. Zo kunnen deepfake-video's van politici of beroemdheden zich snel verspreiden en desinformatie aanwakkeren.

Onderzoekers ontwikkelen tegenmaatregelen, zoals AI-modellen die getraind zijn om subtiele fouten in deepfakes te herkennen, zoals onnatuurlijk knipperen of lichtanomalieën. Maar naarmate detectietechnieken verbeteren, verbeteren ook de methoden om deepfakes te maken, wat leidt tot een voortdurende wapenwedloop.

Experts benadrukken de noodzaak van een veelzijdige aanpak, waarbij AI wordt gecombineerd met menselijk toezicht, mediawijsheidsprogramma's en strengere platformreguleringen. Hoewel AI een krachtige bondgenoot is, is het nog geen waterdichte oplossing voor de nepnieuws-epidemie.

Nederlands

Nederlands

English

English

Deutsch

Deutsch

Français

Français

Español

Español

Português

Português