AI-beeldgeneratoren Voeden Misinformatie

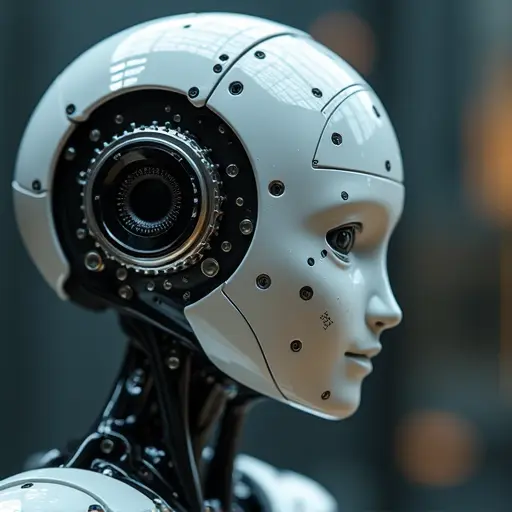

De opkomst van AI-gestuurde beeldgeneratoren brengt zowel innovatie als zorgen met zich mee, vooral in de politieke media. Tools zoals Midjourney, DALL-E en Stable Diffusion kunnen hyperrealistische beelden creëren, maar vormen ook een bedreiging door misinformatie te verspreiden via deepfakes.

Het Deepfake-fenomeen

Deepfakes, een combinatie van 'deep learning' en 'fake,' zijn synthetische media gemaakt met kunstmatige intelligentie. Deze kunnen variëren van gemanipuleerde video's tot AI-gegenereerde beelden die bijna niet van echt te onderscheiden zijn. Hoewel de technologie legitieme toepassingen heeft in entertainment en kunst, is het misbruik ervan voor het verspreiden van nepnieuws en politieke propaganda zorgwekkend.

Politieke Implicaties

Deepfakes zijn gebruikt om valse verhalen te creëren, politieke figuren te imiteren en de publieke opinie te manipuleren. Bijvoorbeeld, vervalste video's van politici die opruiende uitspraken doen, kunnen viraal gaan en echte gevolgen hebben. De jaren 2020 hebben een toename van dergelijke incidenten gezien, wat vragen oproept over de integriteit van democratische processen.

Detectie en Tegenmaatregelen

Onderzoekers ontwikkelen geavanceerde detectietools om deepfakes te identificeren, maar de technologie evolueert snel. Sociale mediaplatforms en overheden zetten ook stappen om misleidende content te markeren en te verwijderen. Desalniettemin blijft de strijd tegen AI-gedreven misinformatie een uitdaging.

Voor meer informatie over deepfakes, bezoek Wikipedia.

Nederlands

Nederlands

English

English

Deutsch

Deutsch

Français

Français

Español

Español

Português

Português