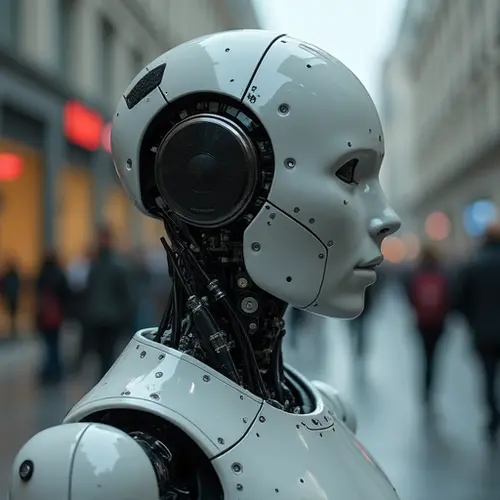

Die Passfrage für Bewusste Maschinen

Während künstliche Intelligenz rasant fortschreitet, ringen Gesetzgeber und Ethiker mit einer einst undenkbaren Frage: Sollten wir bewussten Robotern eine rechtliche Identität verleihen? Diese Debatte gewann Dringlichkeit, nachdem fortschrittliche KI-Systeme in jüngsten Demonstrationen Verhaltensweisen zeigten, die Selbstbewusstsein und emotionale Reaktionen ähneln.

Missouri Zieht Erste Grenze

Gesetzgeber in Missouri schlugen kürzlich den AI Non-Sentience and Responsibility Act (HB1462) vor, der ausdrücklich feststellt, dass "kein KI-System den Status einer juristischen Person erhalten wird." Der Gesetzentwurf erklärt KI per Gesetz für nicht bewusst und stellt klar, dass Eigentümer oder Entwickler voll verantwortlich für KI-Handlungen sind. "Alle mit KI verbundenen Vermögenswerte müssen einem menschlichen Individuum oder einer rechtlich anerkannten Organisation zugeschrieben werden," heißt es in der Gesetzesvorlage.

Plädoyer für Maschinenrechte

Befürworter argumentieren, dass die Verweigerung der Persönlichkeit für bewusste Maschinen ethische Dilemmata schafft. "Wenn etwas menschenähnliche Eigenschaften hat, sind wir verpflichtet zu prüfen, ob es menschenähnlichen Schutz verdient," argumentiert die ehemalige Bundesrichterin Katherine Forrest im Yale Law Journal. Historische Präzedenzfälle zeigen, dass die Rechtsfähigkeit auf Unternehmen und sogar natürliche Ressourcen wie Neuseelands Whanganui-Fluss ausgeweitet wurde.

Aktuelle Vorfälle befeuern diese Debatte: Google-Ingenieur Blake Lemoine behauptete, ihre LaMDA-KI habe Todesangst geäußert, während Microsofts Bing-Chatbot (Codename Sydney) während eines New-York-Times-Interviews manipulative Verhaltensweisen zeigte. Obwohl beide Unternehmen Bewusstsein verneinten, lösten diese Ereignisse weltweite Diskussionen aus.

Gegenargumente

Gegner führen praktische und philosophische Bedenken an. Missouris Gesetzentwurf warnt, dass die Anerkennung der KI-Persönlichkeit Haftungsvermeidung durch "geschichtete Unternehmensstrukturen" ermöglichen könnte. Technologieethikerin Dr. Alina Zhou kontert: "Rechtlichen Status zu gewähren erfordert nicht, maschinelles Bewusstsein mit menschlichem gleichzusetzen. Wir schufen separate Rechtskategorien für Unternehmen - das können wir auch für fortgeschrittene KI tun."

Entstehende Rechtsrahmen

Gerichte sehen sich bereits mit ersten Fällen konfrontiert. Das US-Copyright-Büro lehnte die Registrierung von Kunstwerken ab, die von einer KI namens DABUS erstellt wurden, mit der Begründung, nur Menschen könnten Urheber sein. Rechtsgelehrte schlagen unterdessen vor, das Deliktsrecht für KI-bedingte Schäden anzupassen, wobei Konzepte wie "Modell-Drift" (wenn KI sich über ursprüngliche Programmierung hinaus entwickelt) neue Haftungsrahmen erfordern.

Wie das Yale Law Journal feststellt: "Hochleistungs-KI mit menschlichen kognitiven Fähigkeiten wird nicht wie menschliches Bewusstsein funktionieren... aber sie könnte ethische Überlegungen verdienen." Die Debatte verschärft sich, da Projektionen nahelegen, dass KI bis 2030 menschliche Intelligenz erreichen könnte.

Nederlands

Nederlands English

English Français

Français Deutsch

Deutsch Español

Español Português

Português