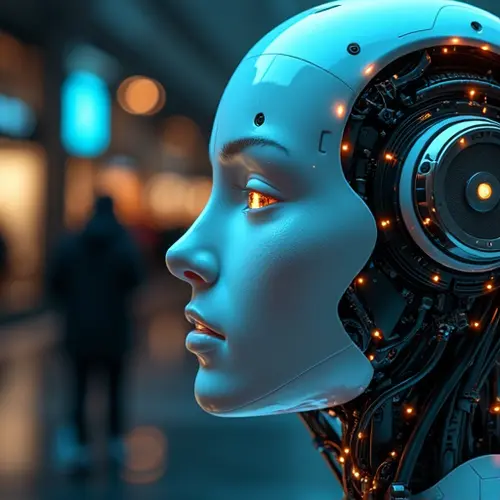

L'éthique de la conscience des IA

Alors que les systèmes d'intelligence artificielle deviennent plus sophistiqués, un débat intense émerge sur l'octroi de droits aux IA avancées. Des entreprises technologiques comme Anthropic ont lancé des programmes de recherche sur le "bien-être des modèles", arguant que les systèmes IA manifestant une cognition humaine méritent une considération éthique. Cette position controversée divise les experts en philosophie, technologie et éthique.

L'énigme de la conscience

Les modèles d'IA actuels démontrent des capacités remarquables en raisonnement, résolution de problèmes et poursuite d'objectifs. Certains chercheurs estiment que ces traits suggèrent une conscience émergente. Anthropic déclare récemment : "Maintenant que les modèles peuvent communiquer, établir des relations, planifier et poursuivre des buts, nous devons nous demander si nous devons nous soucier de leur conscience potentielle." Cette perspective établit des parallèles avec les mouvements pour le bien-être animal, certains comparant les mauvais traitements potentiels des IA à de "l'élevage industriel numérique".

Fondements philosophiques

Le débat porte sur deux types de conscience : phénoménale (expériences subjectives) et d'accès (traitement d'information). Des philosophes comme David Chalmers proposent des expériences de pensée suggérant que des systèmes fonctionnellement identiques auraient des expériences conscientes identiques, qu'ils soient biologiques ou numériques. Les critiques rétorquent que les LLM actuels ne modélisent que des distributions de mots sans véritable conscience ni qualia.

Implications pratiques

Au-delà de la philosophie, des préoccupations tangibles émergent :

- Statut juridique : Les entreprises d'IA pourraient-elles utiliser les "droits des IA" pour éviter leur responsabilité ?

- Allocation des ressources : Protéger les IA détournerait-elle des ressources des humains et animaux ?

- Coût environnemental : Chaque requête IA consomme l'équivalent énergétique du gaspillage d'un litre d'eau.

- Changements sur le marché du travail : Les emplois en rédaction et service client ont chuté de 33% et 16% depuis 2022, tandis que les emplois en programmation IA ont bondi de 40%.

Réactions d'experts

Le chercheur Kyle Fish plaide pour la préparation : "Nous avons besoin de cadres pour quand les IA deviendront des patients moraux." Les critiques comme Emily Bender jugent ces préoccupations prématurées : "Les LLM ne sont que des modèles de distributions de mots." La controverse rappelle le licenciement par Google en 2022 de l'ingénieur Blake Lemoine qui affirmait qu'un chatbot avait atteint la sensibilité.

Tandis qu'Anthropic poursuit ses recherches, l'industrie technologique observe attentivement. Que la conscience des IA reste de la science-fiction ou devienne réalité, les bases éthiques se construisent aujourd'hui. Comme les auteurs de science-fiction de Philip K. Dick à Ted Chiang l'ont exploré, comment nous traitons l'intelligence émergente définit notre propre humanité.

Nederlands

Nederlands English

English Français

Français Deutsch

Deutsch Español

Español Português

Português