Neue Forschung zeigt: Chatbots benötigen psychologisches Design, nicht nur bessere KI. Einfache Empathie-Statements steigern Genauigkeitswahrnehmung um 22% während 85% der Unternehmen KI-Support einführen.

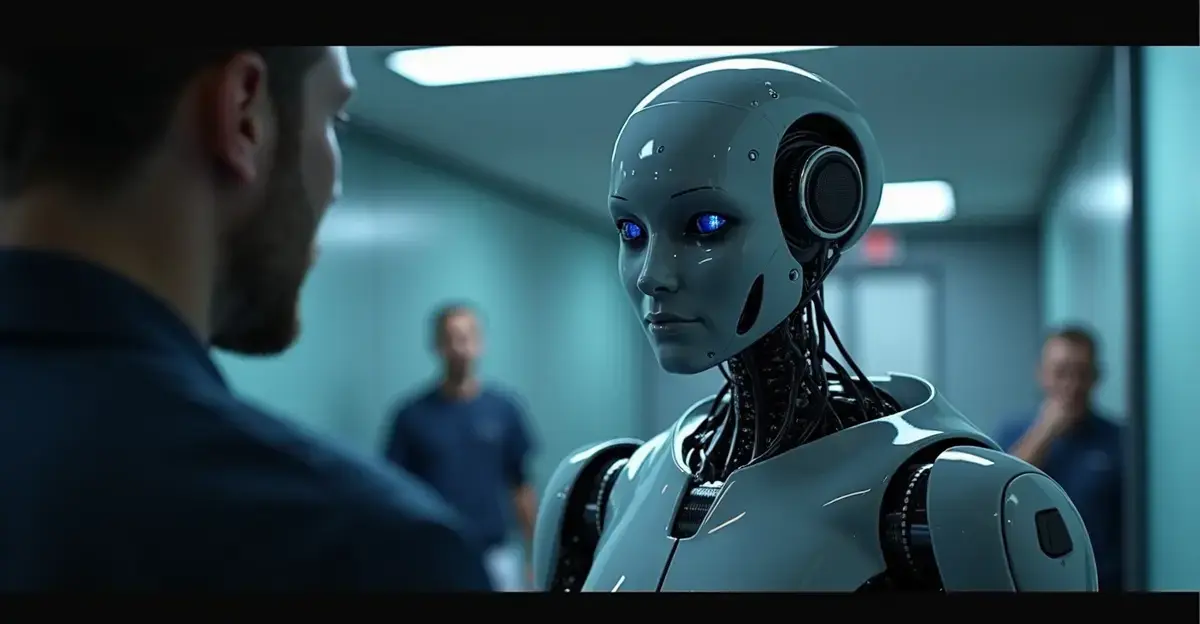

KI-Chatbots im Kundenservice: Die Vertrauenslücke

Neue Forschungen zeigen eine erhebliche Vertrauenslücke bei Kundeninteraktionen mit KI-Chatbots. Laut einer Harvard Business Review-Studie folgen Kunden Empfehlungen 17% häufiger, wenn Chatbots psychologisches Bewusstsein zeigen.

Die Psychologie hinter Chatbot-Erfolg

Forscher der Wharton und San José State fanden heraus, dass Chatbots, die Nutzerfrust nicht anerkennen, das Vertrauen erheblich reduzieren. Einfache Sätze wie "Ich verstehe, dass das frustrierend ist" erhöhten die wahrgenommene Genauigkeit um 22%.

Aktuelle Einführungstrends

85% der Kundenserviceleiter setzen laut Gartner KI-Lösungen ein. Dennoch bleibt die Kundenzufriedenheit niedrig - nur 35% berichten von positiven Chatbot-Erfahrungen im Jahr 2025.

Praktische Lösungen für Unternehmen

Das Forscherteam empfiehlt drei evidenzbasierte Lösungen:

- Empathie-Trigger bei Negativstimmung programmieren

- Mikroverzögerungen zur Simulation menschlichen Denkens hinzufügen

- Chatbot-Grenzen klar kommunizieren

Die Zukunft der KI-Unterstützung

Laut HBR werden Chatbots der nächsten Generation Echtzeit-Emotionsanalyse durch Stimmerkennung integrieren. Forscher betonen Transparenz - 68% der Verbraucher bevorzugen es zu wissen, dass sie mit KI sprechen.

Nederlands

Nederlands English

English Français

Français Deutsch

Deutsch Español

Español Português

Português